どんなにあなたの推定が美しかろうが関係ない。あなたがどんなに頭が良いかは関係ない。誰が推定したかも、彼が誰なのかも関係ない。その推定が実験結果と辻褄が合わなければ、それは間違っているということなんだ。それ以上何もない。

リチャード・ファインマン、物理学者

こんにちは、西田です!

日本も大変暑いと聞いておりますが、私の住むフロリダも相変わらず灼熱な日々が続いております。フロリダの不思議な現象として、実はこの夏時期に毎年風邪が流行ります。普通は北半球の国であれば冬になれば風邪が流行るものですが、その逆です。カリフォルニアに住んでたときから不思議だったのですが、こちらに引っ越してから謎が解けました。

フロリダの夏はあまりにも熱すぎるので、みんなエアコンをガンガンに効かせた家の中に閉じこもり外に出なくなります。実際特に昼間は外はまるでゴーストタウンかのように誰も歩いていません。つまり、他の場所であれば冬に起きる現象がフロリダでは夏に再現されているということです。

そして今年も我が家は一家4人みんなで風邪を引いてしまいました。。。

日本では風邪が流行ることはないとは思いますが、くれぐれも夏バテにはお気をつけ下さい!

それでは、今週もいくつかの記事を紹介したいと思います。

最近の興味深いデータ関連記事

AIによって仕事が失くなる、は本当か?

AIのリスクにはいくつかありますが、今回は「AIによって仕事が失くなる」というリスクに関しての考察になります。

最近のChatGPTやMidjourneyなどに代表される生成AIは、これまでの機会化や自動化と違い、弁護士、コンサルタント、デザイナーといったいわゆるホワイトカラーの仕事、または知的労働者の仕事(の一部)を置き換える可能性があるため、いよいよこれで人間の仕事が失くなってしまうと心配する人も多いのではないでしょうか。

そして、そうした人々の不安を利用し、恐怖を煽ることでユニバーサル・インカムという名の下で共産主義的な政策を売り込む人たちまで出てきます。

そこで、機会化や自動化の歴史を振り返り、さらに経済の基本的な仕組みを理解した上で、今回も冷静にこのリスクを分析してみたいと思います。

ChatGPTは基本的な算数の質がどんどん悪くなる?

Why ChatGPT Is Getting Dumber at Basic Math - Link

How Is ChatGPT’s Behavior Changing over Time? - Link

スタンフォード大学とUCバークレー大学の研究チームによると、ChatGPTの一部の計算能力が時が経つに連れて悪くなっているとのことです。例として、与えられた数字が素数かどうかといったタイプの質問への答えが間違っていることが多くなっているとのことです。

これはChatGPTが過去の大量データを下に、次に来る文字を確率的に予測するものであり、その予測モデルはパラメーターの数だけでも何千億個にも上る大変複雑なものであるという前提に立つと、ある意味想定されていたことです。複雑なAIモデルのある部分を改善しようとすると、別の部分が悪くなってしまうことはよくあり、この世界ではそうしたモデルの予測結果の質が悪くなっていく現象のことを「ドリフト」と言ったりします。

さらに興味深いのは、素数に関する質問など一部の質問に対してはChatGPT−4の正答率が悪くなっているが、1つ前のバージョンであるChatGPT-3.5では正答率が良くなっていたりします。逆に、ChatGPT−4は改善してるがChatGPT−3.5は悪くなっていたり、または両方とも悪くなるようなタイプの質問もあったりするとのことです。

この研究チームのメンバーによると、こうした機械学習やAIで見られるドリフトという現象が、ChatGPTでも「こうした事が起きるのではないかと思っていたが、こんなに早く起き始めていることに驚いた」とのことです。

ChatGPTにおかしな答えを生成させるためにあえてトリッキーな質問を投げたりする人たちへの対策、プロンプト・エンジニアリングと呼ばれるものへの対策、またはChatGPTが返す答えをより簡潔にするための改善、こうした変更がドリフトを生じさせることになったのかもしれません。

しかし、なぜこうした問題が起きるのかはChatGPTの開発者たちにさえ、把握するのは難しいでしょう。それはモデルがあまりにも複雑で人間に理解することはできないからです。

ハードウェアだけでなくソフトウェアも含め一般的なものづくりの感覚からすると、プロダクトやサービスの機能や品質は時間とともに良くなっていくということに私達は慣れていますが、AIに関してはそうとも限りません。一部は良くなるが、そのせいで予想もしなかった別の部分が悪くなる、そういったことが起きてしまい、それがわかったところで、その部分をすぐに直せるというわけではないということです。

それでも、長い目で見ると全体的な質は良くなっていく方向にあるとは思いますが、その軌道は直線ではなく、急に上がったり下がったりと変化の激しい線となることでしょう。

問題は、こうした限界を一般の人達はどこまで許容できるかということです。計算機を使うとき、私達は出てきた答えを「確率的に正しいであろう」とは考えません。「絶対的に正しい」と考えます。しかし、ChatGPTを含め予測モデルはいつも確率的に正しいであろう答えを返すため、常に間違っている可能性があるのです。

そこで自分で確かめる、または誰かドメイン知識を持っている人に確認してもらいながら使っていく必要があります。ここを理解していると、めんどくさい基本的な作業を効率化できる便利なツールとなるのですが、逆にここを怠ると、とんでもない間違いを知らず知らずのうちに犯してしまうことになるので、注意が必要ですね。

メディア、出版社はAI企業にビリオンドル単位の補償を要求

Publishers want billions, not millions, from AI - リンク

ニューヨーク・タイムス、ニューズ・コーポレーションといったアメリカのメディア企業、Springerなどの出版社、そしてメディア関連企業を集めた会社であるIACなどが一緒になってAI企業に対して何千億ドルにも上る訴訟を起こす準備をしているとのことです。

これまでは、みなさんがGoogleで何かのトピックを検索したさい、検索結果に出てくるメディアのページをクリックして該当するページを訪問することになり、それはメディア企業にとってはトラフィックを送り込んでくれるということでありがたいことでもありました。

ところがChatGPTやGoogleのBartなどのサービスが検索ページにに組み込まれるようになると、その場で探している答えが出てくるので、その元となっているメディアのページをユーザーが訪問することがなくなります。

メディアの方からすると、自分たちがお金をかけて作った情報を勝手にデータとして使ったAIエンジンが、ユーザーの質問に答えて解決してしまうのであれば、ビジネスが成り立たなくなるというわけです。

これは、大手のメディアだけでなく、小さな規模で料理のレシピやレストランのレビュー、政治、経済、または医療などの専門分野の解説などブログ記事を書いている人たちにとっても頭の痛い問題です。

ChatGPTなどに代表される新しいAIによる記事生成という破壊的なイノベーションを前に、これまでの広告をベースにしたビジネスモデルとどう共存していくのか、この答えは難しいので、最終的にはアメリカの最高裁判所で決着を見るまで長く続くものとなると思います。

今週のチャート

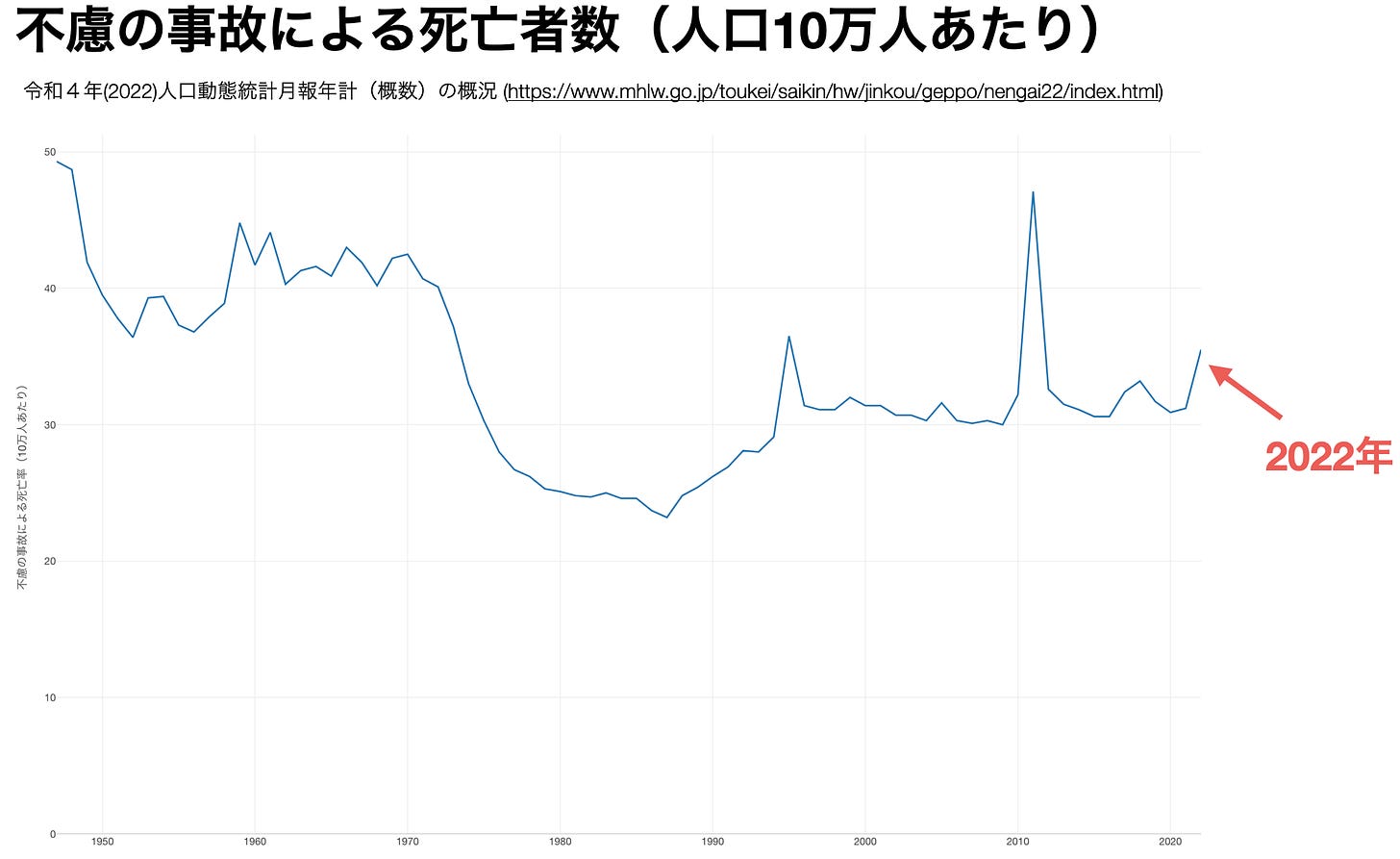

去年、日本で不慮の事故で亡くなられた人の数が例年に比べ多かったのはご存知ですか?

コロナが原因であれば肺炎など別の要因として記録されるでしょう。いや、そうでなく原因不明になる場合もあるというのであれば、その数字は2020年に増加となって現れるはずです。しかしなぜか、2022年に異常に増えているのです。

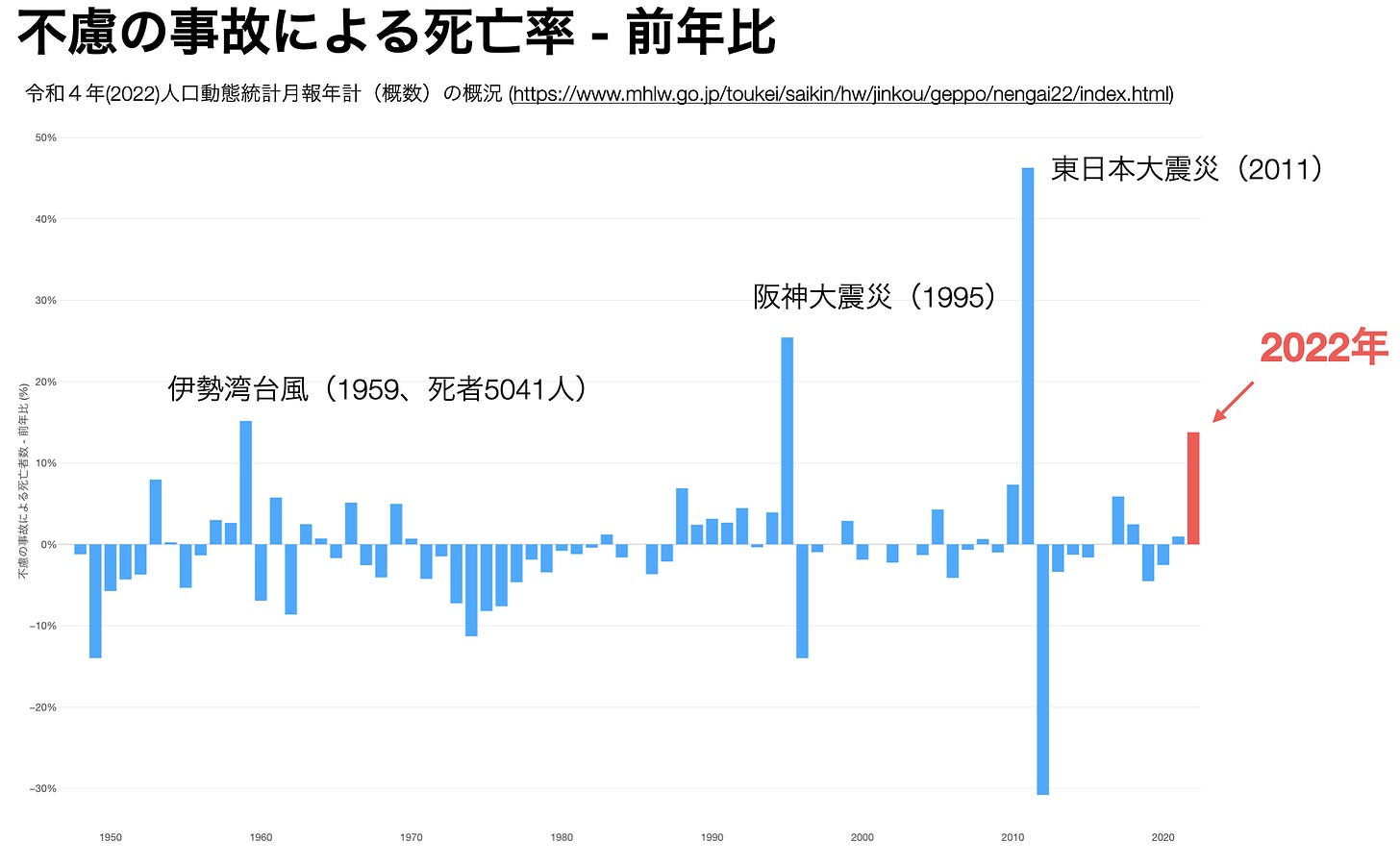

以下は不慮の事故による死亡者数の増減を前年比で表したものです。

過去にも不慮の事故による死亡者数が一気に増えたときはあったのですが、それらはたいてい何らかの自然災害によるものでした。さて、今回は何があったのでしょうか?

分かる人は分かると思いますが、これはなんともひどい人災だと思います。こうした現象は日本だけでなく、世界中、特に欧米でも見られます。そこで一部の国では、国会や裁判所での追及が始まっています。日本でも一刻も早い真相追及が始まることを期待します。

データはこちらの厚生労働省のページからダウンロードできます。

データサイエンス・ブートキャンプ・トレーニング #32

次回のデータサイエンス・ブートキャンプは9月の開催となります。今回もまた東京でクラスルーム形式での開催となります!

ビジネスのデータ分析だけでなく、日常生活やキャリア構築にも役立つデータリテラシー、そして「よりよい意思決定」をしていくために必要になるデータをもとにした科学的思考もいっしょに身につけていただけるトレーニングとなっています。

データサイエンス、統計の手法、データ分析を1から体系的に学ぶことで、ビジネスの現場で使える実践的なスキルを身につけたいという方は、ぜひこの機会に参加をご検討ください!

日時:

2023年9月26日(火), 27日(水), 28日(木)

場所:東京八重洲(対面形式)

データリテラシー・セミナー:AIは誰のものなのか、独占 or 民主化

現在アメリカのテック業界を中心に、規制か自由か、さらには中央集権か民主化なのか、という思想的な対立軸をもとにAIのリスクに関する様々な議論が起きています。

今回のセミナーでは、現在世界中で騒がれているAIのリスクとは何なのかを整理し、それはほんとうに心配すべきなのか、私達がほんらい懸念すべきこととは何なのか、といったことに関して、歴史的、思想的、そして技術的な背景を踏まえて話をしたいと思います。

お時間の都合のつく方はぜひご参加下さい!

日付 : 2023年 9月27日(水)

時間:18:30 - 20:00 - セミナー、20:10 - 懇親会

会場:AP東京八重洲

今回は以上となります。

それでは、素晴らしい週末をお送りください!

西田, Exploratory/CEO

KanAugust